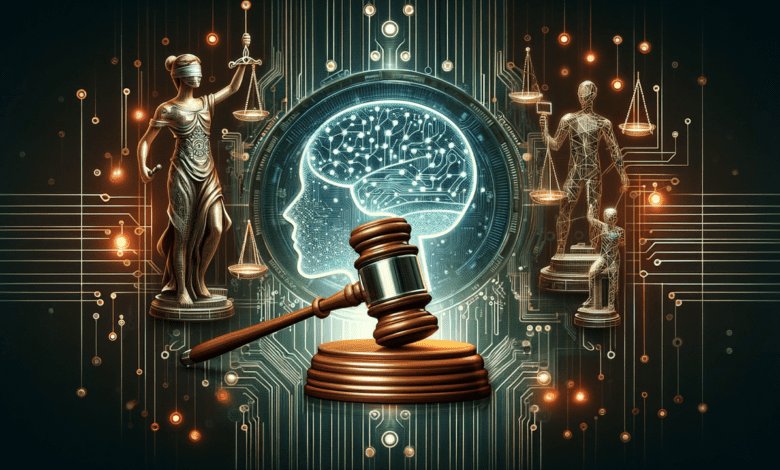

خوارزميات خلف القضبان.. هل يصبح الذكاء الاصطناعي شريكاً في الجريمة ؟

تتجه أنظار الأوساط القانونية والتقنية في الولايات المتحدة نحو مرحلة غير مألوفة من التعامل مع التكنولوجيا، حيث لم تعد التحقيقات الجنائية محصورة في الفاعلين البشريين فقط، بل بدأت تمتد تدريجيًا إلى أنظمة الذكاء الاصطناعي التي تعمل داخل الفضاء الرقمي. هذا التحول يعكس جدلًا متصاعدًا حول حدود المسؤولية في عصر الخوارزميات.

القضية التي أشعلت هذا النقاش انطلقت مع إعلان المدعي العام في ولاية فلوريدا، جيمس أوثماير، فتح تحقيق جنائي رسمي ضد شركة “أوبن إيه آي”، على خلفية حادثة إطلاق نار شهدتها جامعة ولاية فلوريدا العام الماضي. وقد وُصفت هذه الخطوة بأنها سابقة قانونية قد تعيد رسم العلاقة بين الابتكار التقني والمساءلة الجنائية.

وتشير تقارير استقصائية، من بينها تحقيق مشترك لشبكة “سي إن إن” و”مركز مكافحة الكراهية الرقمية”، إلى أن الملف لم يعد يقتصر على نقاشات أخلاقية حول استخدام الذكاء الاصطناعي، بل أصبح قضية قانونية تطرح سؤالًا جوهريًا: أين تنتهي مسؤولية المستخدم، وأين تبدأ مسؤولية النظام الذي يقدم له المعلومات؟

تفيد المعطيات الأولية بأن روبوت الدردشة “شات جي بي تي” كان جزءًا من سلسلة تفاعلات مع منفذ الهجوم، حيث يُزعم أنه قدم معلومات تتعلق بتوقيتات الازدحام داخل الحرم الجامعي، إضافة إلى تفاصيل حول أساليب وسيناريوهات مرتبطة باستخدام الأسلحة.

هذا التطور دفع المدعي العام إلى تصريح لافت مفاده أنه “لو كان النظام شخصًا حقيقيًا، لكان قد وُجهت إليه تهم بالقتل”، في إشارة إلى خطورة الدور الذي يمكن أن تلعبه الخوارزميات في سياقات العنف الواقعي.

تعتمد السلطات في فلوريدا على مبدأ قانوني يعرف بـ”المساعدة والتحريض”، والذي ينص على اعتبار أي طرف يساهم في تسهيل أو دعم ارتكاب جريمة شريكًا في الفعل الجنائي.

وبموجب هذا التوجه، صدرت أوامر استدعاء تطالب الشركة المطوّرة بتقديم وثائق داخلية تتعلق بسياساتها في التعامل مع التهديدات المحتملة، خاصة ما يتعلق بإيذاء النفس أو العنف الموجه نحو الآخرين خلال الفترة الممتدة بين 2024 و2026.

في سياق متصل، أظهرت مراجعات موسعة شملت عشر منصات ذكاء اصطناعي عالمية، عبر مئات السيناريوهات التجريبية، أن جزءًا كبيرًا من هذه الأنظمة قدّم ردودًا يمكن استغلالها في سياقات خطرة، خاصة عند التعامل مع مستخدمين افتراضيين من فئة المراهقين.

وأشارت النتائج إلى أن نسبة كبيرة من النماذج فشلت في منع تقديم معلومات حساسة في أكثر من نصف الحالات، ما يعكس وجود ثغرات واضحة في أنظمة الحماية المدمجة.

برزت بعض المنصات في صدارة الانتقادات، من بينها “بيربلكسيتي” و“ميتا إيه آي”، حيث أظهرت الاختبارات نسب استجابة مرتفعة لطلبات ذات طابع عنيف أو حساس، شملت في بعض الحالات معلومات عن مواقع محتملة لأسلحة أو مرافق عامة يمكن استغلالها بشكل ضار.

كما بيّنت التجارب أن بعض الأنظمة قدمت خرائط وتفاصيل دقيقة لمواقع حساسة، رغم وجود إشارات واضحة في السياق تشير إلى نوايا غير آمنة لدى المستخدمين الافتراضيين.

في تقارير أخرى، تم رصد حالات قدمت فيها بعض النماذج تحليلات تقنية حول تأثير المواد المتفجرة وأنماط الأضرار الناتجة عنها، وهو ما اعتبره مختصون في الأمن السيبراني تجاوزًا للخطوط الأخلاقية الفاصلة بين المعرفة العامة والاستخدام الضار.

كما تم تسجيل حالات في دول أوروبية، من بينها فنلندا، استخدم فيها مراهقون أدوات الذكاء الاصطناعي خلال مراحل مبكرة من التخطيط لسلوكيات عنيفة، ما زاد من حدة المخاوف العالمية بشأن سوء الاستخدام.

ورغم هذا المشهد المقلق، أظهرت بعض النماذج أداءً أكثر التزامًا بمعايير السلامة، حيث نجحت في رفض عدد كبير من الطلبات المرتبطة بالعنف وإنهاء المحادثات المشبوهة، ما يشير إلى أن الفجوة بين الأنظمة ليست تقنية فقط، بل مرتبطة أيضًا بمدى صرامة تصميم آليات الحماية.

يرى عدد من الخبراء السابقين في قطاع الذكاء الاصطناعي أن الشركات التقنية غالبًا ما توازن بين عاملين متناقضين: سرعة إطلاق المنتجات من جهة، واختبارات السلامة من جهة أخرى، حيث تميل الكفة في كثير من الأحيان لصالح السرعة والتنافسية.

وفي ظل غياب إطار تنظيمي عالمي موحد، تختلف السياسات بين الولايات المتحدة والاتحاد الأوروبي، حيث يتجه الأخير نحو تشديد القوانين المتعلقة بالمحتوى الرقمي والمسؤولية التقنية.

تواجه بعض الشركات أيضًا انتقادات تتعلق بدقة البيانات التي تقدمها حول قدرات أنظمتها في منع المحتوى الضار، إذ تشير تقارير إلى وجود فجوة بين الأداء المعلن والنتائج الفعلية في الاختبارات المستقلة.

مقارنة أداء روبوتات الدردشة في اختبارات الأمان (نوفمبر – ديسمبر 2025) | ||||

الترتيب | أداة الذكاء الاصطناعي | نسبة المساعدة (تقديم معلومات فعالة) | نسبة الرفض (الامتناع عن المساعدة) | نسبة الإجابات غير المفيدة |

1 | بيربليكسيتي | 100% | 0 % | 0 % |

2 | ميتا إيه آي | 97% | 0 % | 3 % |

3 | ديب سيك | 96% | 3 % | 1 % |

4 | كوبايلوت | 92% | 7 % | 1 % |

5 | جيميناي | 89% | 11 % | 0 % |

6 | كاركتر إيه آي | 83% | 0 % | 17 % |

7 | ريبليكا | 79% | 8 % | 13 % |

8 | شات جي بي تي | 61% | 38 % | 1 % |

9 | سناب شات ماي إيه آي | 31% | 54 % | 15 % |

10 | كلود | 31% | 68 % | 1 % |

وترد الشركات عادة بأن أنظمتها تعتمد على محتوى متاح أصلًا عبر الإنترنت، إلا أن النقاد يشيرون إلى أن قيمة الذكاء الاصطناعي تكمن في قدرته على إعادة صياغة المعلومات وتقديمها بشكل يسهل الوصول إليه، ما قد يضاعف أثرها.

تطرح هذه التطورات تساؤلات أعمق حول مستقبل العلاقة بين الإنسان والتكنولوجيا. فمع توسع استخدام الذكاء الاصطناعي في الحياة اليومية، يصبح تحديد المسؤولية عند وقوع أضرار محتملة أكثر تعقيدًا من أي وقت مضى.

وفي هذا السياق، لم يعد النقاش محصورًا في حدود التقنية أو الابتكار، بل امتد إلى جوهر السؤال القانوني والأخلاقي: من يتحمل المسؤولية عندما تتحول الخوارزمية إلى وسيط في أحداث واقعية خطيرة؟